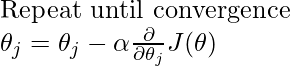

Descenso de gradiente:

el descenso de gradiente es un algoritmo de optimización utilizado para encontrar los valores de los parámetros de una función que minimiza una función de costo. Es un algoritmo iterativo. Usamos gradiente descendente para actualizar los parámetros del modelo. Los parámetros se refieren a coeficientes en regresión lineal y pesos en redes neuronales.

El descenso de gradiente también puede converger incluso si la tasa de aprendizaje se mantiene fija.

Ecuación normal: Ecuación

normal, un enfoque analítico utilizado para la optimización. Es una alternativa para el descenso de gradiente. La ecuación normal realiza la minimización sin iteración.

Las ecuaciones normales son ecuaciones que se obtienen igualando a cero las derivadas parciales de la suma de errores al cuadrado o función de costo; Las ecuaciones normales permiten estimar los parámetros de la regresión lineal múltiple.

Donde

X = valor de características de entrada

y = valor de salida

Si el término ![]() X no es invertible o es singular, entonces podemos usar la regularización.

X no es invertible o es singular, entonces podemos usar la regularización.

Diferencia entre Descenso de Gradiente y Ecuación Normal.

| S. NO. | Descenso de gradiente | ecuación normal |

|---|---|---|

| 1. | En descenso de gradiente, debemos elegir la tasa de aprendizaje. | En la ecuación normal, no es necesario elegir la tasa de aprendizaje. |

| 2. | Es un algoritmo iterativo. | Es un enfoque analítico. |

| 3. | El descenso de gradiente funciona bien con una gran cantidad de funciones. | La ecuación normal funciona bien con un pequeño número de características. |

| 4. | Se puede utilizar el escalado de características. | No es necesario escalar características. |

| 5. | No es necesario manejar el caso de no invertibilidad. | Si ( |

| 6. | La complejidad del algoritmo es O(k n es el número de características. |

La complejidad del algoritmo es O( n es el número de características. |

Publicación traducida automáticamente

Artículo escrito por Chauhanvishesh99 y traducido por Barcelona Geeks. The original can be accessed here. Licence: CCBY-SA