Visión general

La lengua de signos es un lenguaje visual que las personas sordas utilizan como lengua materna. A diferencia de los patrones de sonido transmitidos acústicamente, el lenguaje de señas utiliza el lenguaje corporal

y la comunicación manual para transmitir con fluidez los pensamientos de una persona. Se logra combinando simultáneamente las formas de las manos, la orientación y el movimiento de las manos, los brazos o

el cuerpo y las expresiones faciales. Puede ser utilizado por una persona que tiene dificultades para hablar o por una persona que puede oír pero no puede hablar y por personas normales para comunicarse con personas con discapacidad auditiva. Para una persona sorda, tener acceso a una lengua de signos es muy importante para su crecimiento social, emocional y lingüístico. El lenguaje de señas debe ser reconocido como el primer idioma de las personas sordas y su educación puede ser

se procedió de manera bilingüe en la lengua de señas nacional, así como en la lengua nacional escrita o hablada.

El lenguaje de señas indio es utilizado por personas sordas y con problemas de audición para comunicarse mostrando signos usando diferentes partes del cuerpo. En todo el mundo hay

diferentes comunidades de personas sordas y, por lo tanto, el idioma de estas comunidades será diferente. El lenguaje de señas utilizado en EE. UU. es el lenguaje de señas americano

(ASL); El lenguaje de señas británico (BSL) se usa en Gran Bretaña; y el lenguaje de señas indio (ISL) se usa en la India para expresar pensamientos y comunicarse entre sí. El “lenguaje de señas indio (ISL)” utiliza la comunicación manual y el lenguaje corporal (comunicación no manual) para transmitir pensamientos, ideas o sentimientos. Los signos ISL se pueden clasificar generalmente

en tres clases: señales de una mano, de dos manos y no manuales. Los signos de una mano y los signos de dos manos también se denominan signos manuales en los que el firmante usa sus manos para

hacer los signos para transmitir la información. Los signos no manuales se generan cambiando la postura corporal y las expresiones faciales. Este sistema es para ayudar a las personas con discapacidad auditiva

en la India a interactuar con otros, ya que traduce el texto en inglés al lenguaje de señas.

Objetivos

1. Brindar acceso a la información y servicios a las personas sordas en el lenguaje de señas indio.

2. Desarrollar un proyecto escalable que pueda extenderse para capturar todo el vocabulario de ISL a través de signos manuales y no manuales.

Especificaciones técnicas

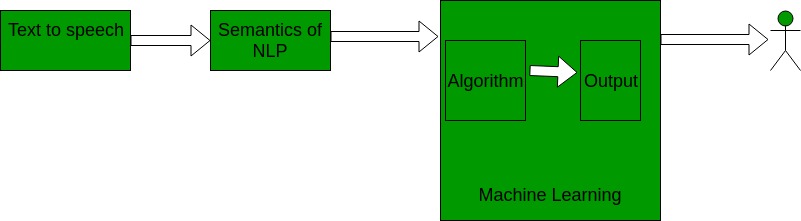

Este proyecto se basa en convertir las señales de audio recibidas en texto usando la API de voz a texto (módulos de Python o API de Google) y luego usar la semántica del procesamiento del lenguaje natural para dividir el texto en partes más pequeñas y comprensibles que se requieren.

Aprendizaje automático como parte. Los conjuntos de datos del lenguaje de señas predefinido se utilizan como entrada para que el software pueda usar inteligencia artificial para mostrar el audio convertido al lenguaje de señas

.

AI (Inteligencia Artificial): es la teoría y el desarrollo de sistemas informáticos para poder realizar tareas que normalmente requieren inteligencia humana, como la percepción visual, el reconocimiento de voz, la toma de decisiones y la traducción entre idiomas.

ML (Machine Learning) – El aprendizaje automático es la ciencia de hacer que las computadoras actúen sin ser programadas explícitamente. Las Entradas se dan como conjuntos de datos por los cuales el sistema aprende y trata de dar el mejor resultado posible al usuario.

PNL (Procesamiento del Lenguaje Natural) – Es la aplicación de técnicas computacionales al análisis y síntesis del lenguaje natural y del habla.

Plataforma Utilizada:

Software Implementado a través de Python

Se implementa una aplicación de escritorio utilizando el lenguaje de programación python. Python

incluye bibliotecas como pyaudio para convertir voz en texto.

– Se prefiere Python 2.7.x.

– Compilador de la edición de la comunidad de Pycharm.

– Sistema Operativo – Ubuntu (Linux).

– Conjuntos de datos ISL/ASL de google.

Metodología

1. Entrada de audio en un Asistente Personal Digital (PDA) utilizando el módulo Python PyAudio.

2. Conversión de audio a texto usando Google Speech API.

3. Analizador de dependencias para analizar la estructura gramatical de la oración y establecer la relación entre las palabras.

4. Generador ISL: ISL de la oración de entrada usando las reglas gramaticales de ISL.

5. Generación de Lengua de Señas con Avatar de señas.

Alcance futuro

1. Dado que las personas sordas generalmente se ven privadas de una comunicación normal con otras personas, tienen que depender de un intérprete o alguna comunicación visual. Ahora el intérprete no puede estar disponible siempre, por lo que este proyecto puede ayudar a eliminar la dependencia del intérprete.

2. El sistema se puede ampliar para incorporar el conocimiento de las expresiones faciales y el lenguaje corporal también para que haya una comprensión completa del contexto y el tono del discurso de entrada.

3. Una versión móvil y web de la aplicación aumentará el alcance a más personas.

4. Integración del sistema de reconocimiento de gestos con las manos usando visión artificial para establecer un sistema de comunicación bidireccional.

Este artículo es una contribución de Ankit Jain . Si le gusta GeeksforGeeks y le gustaría contribuir, también puede escribir un artículo usando contribuya.geeksforgeeks.org o envíe su artículo por correo a contribuya@geeksforgeeks.org. Vea su artículo que aparece en la página principal de GeeksforGeeks y ayude a otros Geeks.

Escriba comentarios si encuentra algo incorrecto o si desea compartir más información sobre el tema tratado anteriormente.

Publicación traducida automáticamente

Artículo escrito por GeeksforGeeks-1 y traducido por Barcelona Geeks. The original can be accessed here. Licence: CCBY-SA