Requisito previo:

El siguiente artículo analiza los modelos lineales generalizados (GLM) que explican cómo la regresión lineal y la regresión logística son miembros de una clase de modelos mucho más amplia. Los GLM se pueden usar para construir modelos para problemas de regresión y clasificación usando el tipo de distribución que mejor describa los datos o las etiquetas dadas para entrenar el modelo. A continuación se presentan algunos tipos de conjuntos de datos y las distribuciones correspondientes que nos ayudarían a construir el modelo para un tipo particular de datos (El término datos especificado aquí se refiere a los datos de salida o las etiquetas del conjunto de datos).

- Datos de clasificación binaria: distribución de Bernoulli

- Datos de valor real: distribución gaussiana

- Datos de conteo: distribución de Poisson

Para comprender los GLM, comenzaremos definiendo familias exponenciales. Las familias exponenciales son una clase de distribuciones cuya función de densidad de probabilidad (PDF) se puede moldear de la siguiente forma: ![]()

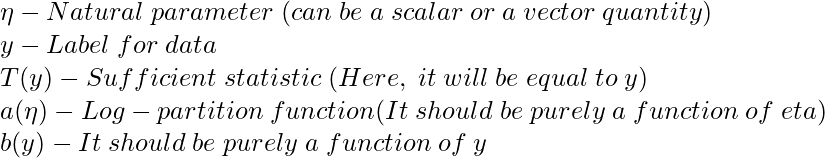

Prueba : la distribución de Bernoulli es un miembro de la familia exponencial.

Por lo tanto, al comparar Eq1 y Eq2 : ![]()

![]()

Nota: Como se mencionó anteriormente, el valor de phi (que es el mismo que la función de activación o sigmoide para la regresión logística) no es una coincidencia. Y se demostrará más adelante en el artículo cómo se puede derivar el modelo de regresión logística de la distribución de Bernoulli.

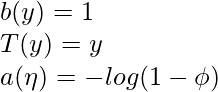

Prueba : la distribución gaussiana es un miembro de la familia exponencial.

Por lo tanto, al comparar Eq1 y Eq3 :

Construcción de GLM:

para construir GLM para un tipo particular de datos o, de manera más general, para problemas de clasificación lineal o logística, se deben considerar las siguientes tres suposiciones u opciones de diseño: ![Rendered by QuickLaTeX.com y|x;\theta \sim exponential\hspace{1mm} family(\eta)\\ Given \hspace{1mm}x\hspace{1mm} our\hspace{1mm} goal\hspace{1mm} is\hspace{1mm} to\hspace{1mm} predict \hspace{1mm}T(y)\hspace{1mm} which \hspace{1mm}is \hspace{1mm}equal \hspace{1mm}to\hspace{1mm} y \hspace{1mm}in\hspace{1mm} our\hspace{1mm} case \hspace{1mm}or \hspace{1mm}h(x) = E[y|x] = \mu\\ \eta = \theta^T * x](https://www.geeksforgeeks.org/wp-content/ql-cache/quicklatex.com-83dd66a8f08d70eb7f6e41aa25bc2c5d_l3.png)

La primera suposición es que si x son los datos de entrada parametrizados por theta, la salida resultante o y será un miembro de la familia exponencial. Esto significa que si se nos proporcionan algunos datos etiquetados, nuestro objetivo es encontrar los parámetros theta correctos que se ajusten lo más posible al modelo dado. El tercer supuesto es el menos justificado y puede considerarse como una elección de diseño.

Modelo de Regresión Lineal:

Para mostrar que la Regresión Lineal es un caso especial de los GLM. Se considera que las etiquetas de salida son valores continuos y por tanto una distribución gaussiana . Entonces, tenemos ![Rendered by QuickLaTeX.com y|x;\theta \sim \mathcal{N}(\mu, \sigma^2) \\ h_\theta(x) = E[y|x;\theta]\\ \hspace{0.9cm} = \mu\\ \hspace{0.9cm} = \eta\\ \hspace{0.9cm} = \theta^Tx](https://www.geeksforgeeks.org/wp-content/ql-cache/quicklatex.com-bc54a24fc49c8d6c303c025e8e6ee8d1_l3.png)

La primera ecuación anterior corresponde a la primera suposición de que las etiquetas de salida (o variables objetivo ) deben ser miembros de una familia exponencial. La segunda ecuación corresponde a la suposición de que la hipótesis es igual al valor esperado o la media de la distribución . y por último, la tercera ecuación corresponde a la suposición de que el parámetro natural y los parámetros de entrada siguen una relación lineal.

Modelo de Regresión Logística:

Para mostrar que la Regresión Logística es un caso especial de los GLM. Se considera que las etiquetas de salida tienen valores binarios y, por lo tanto, son una distribución de Bernoulli . Entonces, tenemos ![Rendered by QuickLaTeX.com y|x;\theta \sim Bernoulli(\phi) \\ h_\theta(x) = E[y|x;\theta]\\ \hspace{0.9cm} = \mu\\ \hspace{0.9cm} = 1/1+e^{-\eta}\\](https://www.geeksforgeeks.org/wp-content/ql-cache/quicklatex.com-81a7b954d2c58ca2af4b1d94da3dae09_l3.png)

De la tercera suposición, se prueba que:

La función que mapea el parámetro natural al parámetro canónico se conoce como la función de respuesta canónica (aquí, la función de partición logarítmica) y la inversa de la misma se conoce como la Función de enlace canónico .

Por lo tanto, al utilizar los tres supuestos mencionados anteriormente, se puede probar que la regresión logística y lineal pertenece a una familia mucho más grande de modelos conocidos como GLM.

Referencia:

Publicación traducida automáticamente

Artículo escrito por amanbhutani263 y traducido por Barcelona Geeks. The original can be accessed here. Licence: CCBY-SA