Prerrequisitos: Red adversaria general

Aunque las redes adversarias generativas son redes neuronales muy poderosas que se pueden usar para generar nuevos datos similares a los datos con los que se entrenó, están limitadas en el sentido de que solo se pueden entrenar con datos monomodales, es decir, datos cuya variable dependiente consta de una sola entrada categórica.

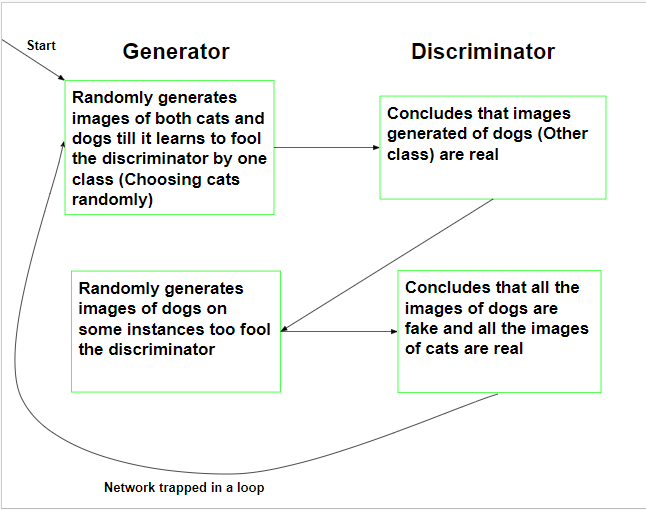

Si una Red Adversaria Generativa se entrena en datos multimodales, conduce al Colapso Modal . Colapso modal se refiere a una situación en la que la parte generadora de la red genera solo una cantidad limitada de variedad de muestras, independientemente de la entrada. Esto significa que cuando la red se entrena directamente con datos multimodales, el generador aprende a engañar al discriminador generando solo una variedad limitada de datos.

El siguiente diagrama de flujo ilustra el entrenamiento de una Red Adversaria Generativa cuando se entrena sobre un conjunto de datos que contiene imágenes de perros y gatos:

Los siguientes enfoques se pueden utilizar para abordar el colapso modal: –

- Agrupación de las clases: uno de los métodos principales para abordar el Colapso modal es agrupar los datos según las diferentes clases presentes en los datos. Esto le da al discriminador el poder de discriminar sublotes y determinar si un lote determinado es real o falso.

- Anticipación de contraacciones: este método se enfoca en eliminar la situación del discriminador «persiguiendo» al generador entrenando al generador para engañar al máximo al discriminador teniendo en cuenta las contraacciones del discriminador. Este método tiene la desventaja de aumentar el tiempo de entrenamiento y complicar el cálculo del gradiente.

- Aprender de la experiencia: este enfoque implica entrenar al discriminador en las antiguas muestras falsas que generó el generador en un número fijo de iteraciones.

- Redes Múltiples: Este método implica entrenar múltiples redes Generativas para cada clase diferente cubriendo así todas las clases de datos. Las desventajas incluyen un mayor tiempo de entrenamiento y una reducción típica en la calidad de los datos generados.

Publicación traducida automáticamente

Artículo escrito por AlindGupta y traducido por Barcelona Geeks. The original can be accessed here. Licence: CCBY-SA